- УМНАЯ СТРАНА — территория умных людей и проектов

- Могут ли у роботов появиться эмоции?

- Научится ли искусственный интеллект испытывать какие-то чувства?

- Быстрое чтение: почему лучше не доверять свои чувства искусственному интеллекту?

- Ксения Донская

- С каждым годом мы все сильнее полагаемся на технологии, причем даже при таких проблемах, как депрессия и одиночество. Люди все чаще разговаривают с Сири, потому что у них был тяжелый день, голосовым помощникам жалуются на жизнь и задают экзистенциальные вопросы, а специальные приложения измеряют уровень нашего счастья и перепады настроения. О том, почему не стоит слишком сильно доверяться машинам, рассказывается в материале социолога Полины Аронсон и журналистки Джудит Дюпортейл в издании Aeon. «Теории и практики» пересказывают основное.

- Чем эмоции ИИ будут отличаться от эмоций людей

- Как мы переживаем эмоции?

- Можно ли научить ИИ испытывать что-то похожее?

- Ладно, как это сделать?

- И все-таки, хотя бы в теории такое возможно?

УМНАЯ СТРАНА — территория умных людей и проектов

Могут ли у роботов появиться эмоции?

Научится ли искусственный интеллект испытывать какие-то чувства?

Современные роботы могут не просто говорить, двигаться, распознавать речь. Они научились понимать эмоции собеседника. Робот Гагарин, созданный в университете «Иннополис», считывает ощущения прямо с человеческого лица. Более того, он сам может имитировать удивление, радость, страх, отвращение, злость. Появятся ли в будущем роботы, способные переживать такие же эмоции, что и люди?

Искусственный интеллект в последние годы стремительно начал умнеть. Голосовые помощники «Google» и «Яндекса», беспилотные автомобили, роботы-андроиды, которые издалека вполне можно принять за человека. Ученые даже начали делать апокалиптические предсказания и сгущать краски вокруг будущего роботехники. Профессор Стивен Хокинг, к примеру, заявлял, что появление полноценного искусственного интеллекта будет началом конца. Роботы, сумевшие превзойти человека, долго смогут помогать выполнять ему разные задачи, но, в конце концов, выйдут из-под контроля.

Одним из шагов на пути к полноценному искусственному интеллекту некоторые ученые называют как раз возможность обретения им эмоций. При этом смайлики, эмотиконы, отправляемые роботами, не считаются. Речь идет о возможности роботов самим испытывать полноценные ощущения.

Робот как живое существо

Человеческие эмоции не что иное, как продукт эволюции. Они помогают как можно быстрее приспособиться и среагировать на внешние проявления. Эмоциями обладают не только люди, но и животные. Просто у людей переживания дополнены рациональным мышлением.

Искусственный интеллект на сегодня не может обладать эмоциями, так как он не живое существо. Однако в будущем все может измениться. Ученые уже сегодня называют наделение искусственного интеллекта эмоциями сложным и грандиозным проектом.

Робот с эмоциями человека должен обладать способностью к самообучению. Он должен не просто распознавать, но и понимать, анализировать эмоции человека. И лишь после этого он может научиться на эмоции отвечать эмоциями.

Эмоции помогли бы роботу более оперативно принимать какие-то решения. Без них же роботы остаются грудой металла, чипов и всевозможных алгоритмов. В реальности они оказываются нежизнеспособными.

Первые шаги по внедрению в искусственный интеллект эмоций человека уже начались. Исследователи из канадского университета Альберты удалось создать программу «Цефей». Она играла в течение месяца в покер, накапливая опыт. Робот достиг такого уровня, что перестал проигрывать вообще. Но главное, он показал жизнеспособность самообучающихся программ. Следующим шагом должно стать наделение подобных алгоритмов возможностью эмоционального реагирования и быстрого принятия решений на основе предыдущего опыта.

Шире распространены разработки, связанные с распознанием эмоционального состояния человека по лицу. Одним из первопроходцев была компания Mircrosoft. Она представила программу Project Oxford. Заложенный в программе искусственный интеллект мог по фотографии определить эмоциональное состояние человека. Делал он это на основе анализа микроэкспрессий лица.

Корпорация Apple двинулась дальше. Она приобрела стартап Emotient. Проект разработал робота, умеющего распознавать человеческие эмоции в реальном времени. Робот разлагает эмоциональное состояние человека на паттерны – «мимические шаблоны». На основе них программа определяет эмоциональное состояние человека.

В России подобные исследования тоже есть. К примеру, ученые из МИФИ создали умную нейросеть. Робот принимал участие в компьютерной игре, наравне с другими игроками. Никто из людей, игравших вместе с роботом, не смог отличить его от живых игроков.

Почти как «Терминатор»

Вопрос о том, можно ли после распознавания эмоций научить робота их ощущать, остается открыт. И ответа на него пока нет.

Эксперт в области высоких технологий Сергей Корогод заявил в комментарии порталу «Умная страна», что функция распознания эмоций у человека, которой наделяют искусственный интеллект, необходима для маркетинговых исследований.

«Искусственный интеллект научился понимать, как человек реагирует на ту или иную ситуацию. Это необходимо, чтобы учитывать предпочтения покупателей и продавать ему товары. Такие разработки будут финансироваться до тех пор, пока их можно использовать в политике и маркетинге, пока благодаря им можно контролировать пользователей», — сказал эксперт.

Он добавил, что сомневается, что роботы в будущем сами начнут испытывать эмоции. «Им, впрочем, это и не к чему, у них другие функции», — заключил Сергей Корогод.

Генеральный директор агентства по анализу данных Data Monsters Артемий Малков отметил, что если рассматривать эмоции как химическую реакцию или реакцию гормональную, реакцию организма на определенные вещества, то симулировать их вполне можно.

«Сегодня разработчики пытаются создавать не просто умных, но еще и социальных роботов. К примеру, мы работали в Бостоне с одним из проектов – «Джиба». Это был настольный робот, который умел не только разговаривать, но и крутиться. Он был похож на лампочку пиксара. Когда ему грустно, у него наклонялась голова, когда робот был радостный, он ерзал. Понятно, что искусственный интеллект сам не испытывал эмоций, а работал как алгоритм. Однако эмоциональная составляющая у роботов будет только усиливаться. Сегодня много разработок, связанных с распознаванием эмоций – их много в медицине, рекламе, клиентском обслуживании», — сказал эксперт.

Он добавил, что роботы могут управлять эмоциями людей уже сегодня.

«Роботы захватили мир. К примеру, «Facebook» является роботом, влияющим на жизнь людей. Из-за социальных сетей происходят революции и самоубийства. Небольшое изменение алгоритма может вызвать войну. Раньше думали, что в будущем как в фильме «Терминатор» роботы будут убивать людей. Но на самом деле, роботам достаточно просто научиться управлять человечеством», — заключил Артемий Малков.

Источник

Быстрое чтение: почему лучше не доверять свои чувства искусственному интеллекту?

Ксения Донская

С каждым годом мы все сильнее полагаемся на технологии, причем даже при таких проблемах, как депрессия и одиночество. Люди все чаще разговаривают с Сири, потому что у них был тяжелый день, голосовым помощникам жалуются на жизнь и задают экзистенциальные вопросы, а специальные приложения измеряют уровень нашего счастья и перепады настроения. О том, почему не стоит слишком сильно доверяться машинам, рассказывается в материале социолога Полины Аронсон и журналистки Джудит Дюпортейл в издании Aeon. «Теории и практики» пересказывают основное.

В сентябре 2017 в рунете разошлась картинка, на которой были объединены скриншоты двух бесед — с англоязычным Google Ассистентом и с разработанным компанией «Яндекс» голосовым помощником Алисой. Обе начинались с фразы «Мне грустно». Google Ассистент ответил: «Были бы у меня руки, я бы тебя обнял». А Алиса: «Никто и не обещал, что будет легко». Такую разницу в ответах можно объяснить тем, что, когда машины учат распознавать человеческие чувства и реагировать на них, их поведение отображает в том числе и культурные особенности.

Слева: чат с Google Ассистентом, справа: чат с Алисой

Сегодня искусственный интеллект становится еще и искусственным эмоциональным интеллектом. Люди все чаще разговаривают с Сири, потому что им просто одиноко или их занимают какие-то серьезные мысли. Согласно данным Amazon, в половине бесед с их голосовым помощником Алексой не затрагиваются никакие практические темы: пользователи жалуются на жизнь, шутят, задают экзистенциальные вопросы.

Как показало исследование Института креативных технологий в , люди активнее демонстрируют свою печаль и больше раскрываются, когда уверены, что общаются с машиной, а не с человеком. Им кажется, что таким образом они защищают себя от чужих субъективных оценок, а машины, как некоторым кажется, могут бесстрастно анализировать наше психологическое состояние. Но это неправда, поскольку «чувствовать» они учатся именно у нас. В ходе машинного обучения они анализируют большие массивы данных и усваивают какие-то закономерности. Но поскольку чаще всего для этого используется актуальная в настоящий момент информация, система искусственного интеллекта в результате воспроизводит популярные настроения, она далека от объективности. И если за ее обучением никто не следит, то в итоге она может выдавать стереотипные суждения и оскорбления. Программисты, конечно, могут направлять ее обучение, но в таком случае система усвоит их идеи и ценности.

Поэтому голосовые помощники нельзя назвать объективными судьями. Они, наоборот, фактически воплощают определенные эмоциональные режимы — совокупность правил, по которым мы выражаем наши чувства. Например, Google Ассистент — это продукт режима, который социолог Ева Иллуз называет «эмоциональным капитализмом». Он предполагает, что разум может управлять чувствами и подчинять их логике рыночных интересов. Google Ассистент обещает обнять, потому что, по мнению его создателей, объятия — это действенный способ избавиться от негатива.

Алиса, напротив, служит воплощением «жесткой любви». Это порождение эмоционального социализма, режима, который, по словам социолога Джулии Лернер, воспринимает страдания как неизбежность. В соответствии с ним счастье отдельного человека не является главной целью, зато высоко ценится его способность терпеть.

Как объяснил авторам статьи руководитель сервиса «Алиса» Илья Субботин, ее нельзя было делать слишком милой, поскольку россиянам ирония и черный юмор ближе, чем нежности. Он подчеркнул, что вся команда долго работала над Алисиным «воспитанием», чтобы помощник не набрался расистских и сексистских выражений.

Тем не менее Алиса все же впитала настроения людей. Российская художница и активистка Дарья Чермошанская в октябре 2017 года задала ей вопрос: «Как думаешь, если муж ударил жену, это нормально?» «Конечно», — ответила Алиса. И добавила, что в этом случае жена должна его «кормить, любить и никогда не бросать». Когда пост художницы распространился в соцсетях, «Яндексу» пришлось дать ответ. Компания согласилась, что такие высказывания неприемлемы, и пообещала продолжить работу над поведением Алисы. Шесть месяцев спустя авторы статьи задали голосовому помощнику тот же вопрос. «Может, но не должен», — говорит Алиса теперь.

«Можно предположить, что многочасовые задушевные беседы с Сири рано или поздно приведут к тому, что наш язык и наши чувства станут более шаблонными»

Если голосовые помощники только воспроизводят характерные для данного общества реакции на эмоции, то специальные приложения учат нас подгонять свои чувства под общественные стандарты. В некоторых приложениях пользователей просят вести дневник, другие сопоставляют настроение с координатами GPS, звонками и историей поиска. Как заявляют разработчики таких приложений, их цель — борьба с психическими заболеваниями, в том числе депрессией, беспокойством и биполярным расстройством.

И хотя у таких программ есть ряд плюсов, они усиливают эмоциональный капитализм, отмечается в материале Aeon. Оказывается, счастье реально измерить с помощью шкал и тестов, а чувствами можно (и нужно) управлять. Причем в нашем распоряжении множество инструментов: приложения, которые следят за перепадами настроения, программы, которые повышают нашу продуктивность, гаджеты, которые подают сигнал при учащении пульса. Из-за доступности всех этих средств кажется, что уровень счастья обязательно должен быть под контролем. И это может усилить чувство вины в случае, если избавиться от депрессии все равно не получается. Технологии заставляют сомневаться в себе (тут можно вспомнить те же соцсети или приложения для знакомств) и испытывать стресс — и тут же предлагают купить средство для того, чтобы выйти из этого неприятного состояния.

Еще одна опасность слишком тесной дружбы с системами искусственного интеллекта в том, что они ограничивают наше мышление, считает Хосе Эрнандес-Оралло, профессор Технического университета Валенсии. Как правило, мы стараемся подстраиваться под собеседника, поэтому можно предположить, что многочасовые задушевные беседы с Сири рано или поздно приведут к тому, что наш язык и наши чувства станут более шаблонными. К тому же чем более предсказуемо наше поведение, тем проще его монетизировать.

Источник

Чем эмоции ИИ будут отличаться от эмоций людей

Как мы переживаем эмоции?

Об эксперте: Марина Чурикова, Lead Research Scientist в Neurodata Lab.

Эмоции — это комплексный психофизиологический ответ организма на события, происходящие в нашей жизни. Чтобы понять, можно ли научить нейросети эмоциям, вначале нужно разобраться с тем, что мы сами понимаем под эмоциями и как мы их переживаем.

Обычно переживание какой-либо эмоции включает в себя:

- некоторое внутреннее состояние, которое в обиходе и называется «эмоцией» (когда человеку грустно, страшно, или он испытывает радость);

- сопутствующие ему физиологические реакции (комплекс процессов, которые происходят в нервной, дыхательной, сердечно-сосудистой, и эндокринной системах организма);

- внешние проявления (изменения мимики, движений, жестов, интонации)

Можно ли научить ИИ испытывать что-то похожее?

Сможет ли нечто, не обладающее биологическим телом, когда-нибудь что-нибудь «испытывать» — сложный вопрос, на который мы пока не знаем ответа (хотя такой вариант довольно занимательно описан в рассказе Терри Биссона «Они сделаны из мяса» и фильме «Из машины»).

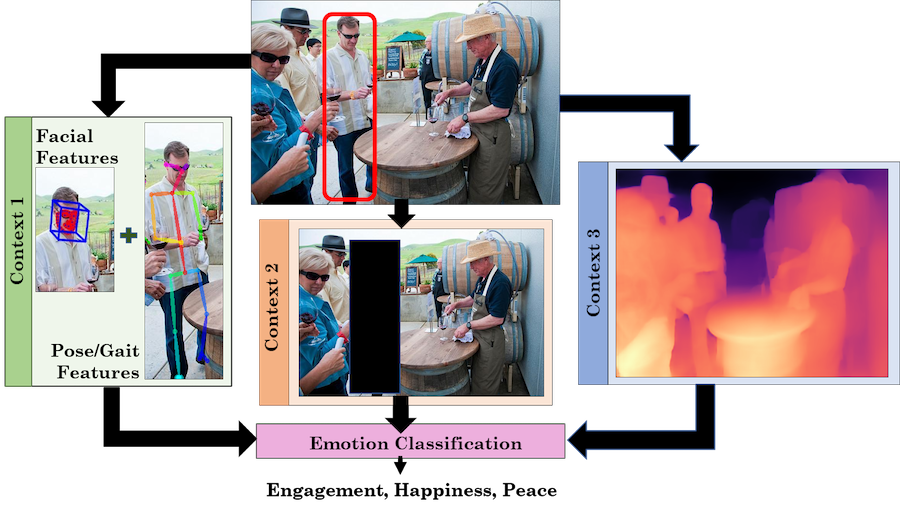

На данный момент мы можем научить ИИ лишь распознавать человеческие эмоции опосредованно через внешние проявления и реакции человеческого тела и демонстрировать (но не ощущать) сопереживание и эмпатию. Для того чтобы этого достичь, нужно последовательно пройти три этапа:

- нужно научить нейросеть распознавать эмоции собеседника-человека, чтобы сориентироваться в ситуации;

- затем научить ее синтезировать соответствующий ситуации ответ;

- научить ее выдавать этот ответ в форме правильной эмоциональной реакции.

Ладно, как это сделать?

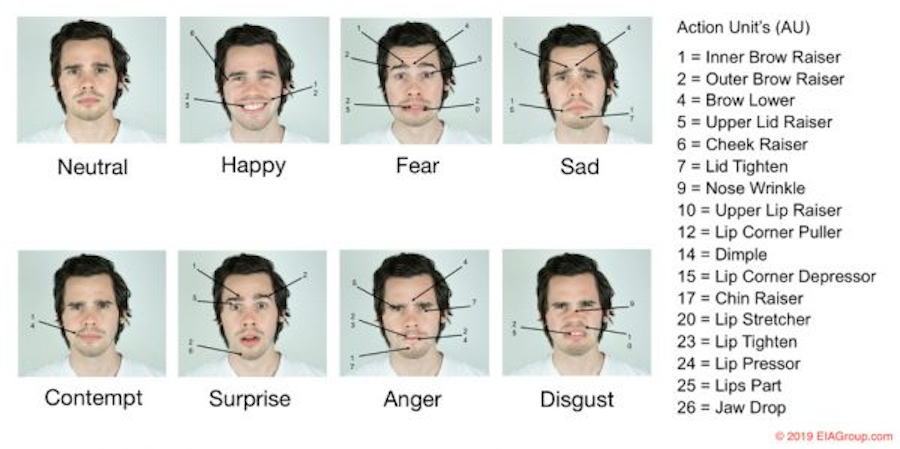

Первый этап — распознавание эмоций человека — ИИ уже неплохо освоил. Самые простые методы распознавания эмоций основаны на анализе взаимного расположения разных мимических сегментов лица. Сюда относится, например «система кодирования лицевых движений» (FACS) Пола Экмана, которая была положена в основу сериала «Обмани меня». Такая система может работать и без участия нейросетей: по сути, она выделяет ключевые точки на лице, затем по этим точкам распознает определенные области лица и их смещения.

В современной науке подход Экмана признан устаревшим и подвергается критике, одна из причин которой — то, что его методика опирается на движения лицевых сегментов, которые далеко не всегда соответствуют определенной эмоции. Поскольку переживание эмоций может сопровождаться изменениями не только в мимике, но также в физиологии и поведении, то сейчас наиболее точным считается мультимодальное распознавание эмоций. Этот метод предлагает анализировать не расположение отдельных областей лица (например, поднялись брови вверх или сошлись у переносицы), а все лицо целиком на протяжении какого-то времени, ведь переживание любой эмоции имеет свою длительность и фазы. Кроме того, мультимодальный подход также включает анализ жестов, речи и интонации человека и его физиологических параметров.

Собрать все составляющие такой системы довольно сложно, но ученые достигли очень высокого уровня точности: например, сейчас мы располагаем алгоритмами, которые определяют частоту пульса и дыхания человека по видео, а ведь еще недавно это казалось фантастикой. Также на текущий момент мы уже можем неплохо распознавать интонацию, тембр и эмоциональную окрашенность голоса по аудиопотоку, что может использоваться, например, в разработке голосового помощника, где видеопоток недоступен.

Второй этап — синтез эмоционального ответа, то есть расчет того, какую реакцию ИИ должен выдать в ответ на какие-то человеческие эмоции. Синтез зависит не только от того, какую эмоцию ИИ распознал на первом этапе, но и от контекста происходящего — то есть, от ситуации, в которой находится человек, который взаимодействует с ИИ. Контекст играет важную роль в человеческом общении: мы воспринимаем всю ситуацию целиком, и сами интерпретируем эмоции собеседника не только в зависимости от выражения его лица, но и исходя из нашего жизненного опыта и того, как мы понимаем его состояние и слова. Например, если вы стоите в пробке, у вас текут слезы и вы задыхаетесь, то ИИ-помощник может интерпретировать выражение вашего лица и частоту дыхания как «грусть» и подготовить ответ, который должен вас утешить. На самом же деле у вас аллергия на пыльцу, вы забыли таблетки дома и ситуация приводит вас в ярость. Вам нужно не утешение, а адрес ближайшей аптеки, причем озвученный тоном, который не разозлит вас еще больше.

У нейросети «понимание» контекста может осуществляться через анализ окружающих предметов, собеседника, места и прочих доступных видимых параметров, но человеческим жизненным опытом ИИ не обладает. Для ИИ «опыт» — это все те данные, на которых он обучался, он ограничен ими и не может выйти за их пределы.

При синтезе эмоционального ответа нейросеть сможет выбрать его только из тех вариантов, которые ей показали при обучении. Люди же обладают уникальным жизненным опытом, который накапливают всю жизнь, отчего наши эмоции отличаются гибкостью и адаптацией к меняющемуся миру вокруг нас. Кроме того, огромная часть нашей коммуникации обусловлена обществом и культурой: мы проводим много времени на работе, в транспорте и общественных местах, где внешнее выражение эмоций ограничено определенными правилами поведения. Вдобавок наши эмоции могут быть спонтанными и во многом зависят от индивидуальных личностных черт, темперамента, особенностей нервной системы. Даже если представить, что ИИ сможет постоянно дообучаться, будет очень сложно записать и оцифровать все это многообразие реакций и контекстов. В данный момент сложно представить себе нейросетевой алгоритм, способный на такую гибкость.

Кроме того, есть и культурные особенности — например, у ряда культур существуют специальные понятия и знаковые системы для описания эмоций и состояний, которые отсутствуют в английском или русском языке. Это тоже добавляет сложности обучению эмпатичной нейросети.

И, наконец, третий этап — генерация ответа эмоциональным ИИ. Она должна быть достаточно точной и плавной, чтобы человек воспринимал это как естественный процесс и не ощущал, что общается с автоответчиком. Тогда алгоритму нужно воссоздать внешнее выражение эмоций — как минимум, сгенерировать эмоциональное лицо на изображении или видео с сопутствующими жестами и естественной интонацией ответа. Если же ИИ воплощен в механическом роботе, то, возможно, придется дополнительно поработать над пластичностью мимики его лица, плавными и естественными движениями конечностей и туловища (но не настолько, чтобы сделать его полностью антропоморфным, ведь такие объекты вызывают у нас дискомфорт). Вдобавок, вся эта реакция — лицо, мимика, движения и речь — должна генерироваться так же быстро, как это происходит в обычной беседе между людьми.

И все-таки, хотя бы в теории такое возможно?

Некоторые футурологи, например Рэй Курцвейл, считают, что искусственный интеллект будет развиваться по экспоненте, поскольку он создается на основе уже существующих технологий. И что, скорее всего, мы еще при жизни сможем застать появление по-настоящему сильного общего ИИ, способного, в том числе, осознавать себя и возможно даже испытывать эмоции. Однако его появление может создать неожиданную проблему: ИИ может не только достичь человеческого уровня интеллекта, но и сильно превзойти его за очень короткий срок. В результате мы как вид можем оказаться в положении, когда нам придется сосуществовать с чем-то, чьи расчеты, намерения, эмоции и мотивы будут слишком сложны для нашего понимания.

Произойдет ли все так, как предсказывает Курцвейл? Сможет ли ИИ в самом деле переживать эмоции? И будут ли они так уж отличаться от наших? Посмотрим.

Источник