- Могут ли у робота быть эмоции?

- Каким должен быть робот?

- Научные исследования

- Первый эксперимент

- Вторая группа

- Каков же результат?

- Выводы

- Что насчет «чтения» эмоций в состоянии стресса?

- Результаты второго исследования

- У ботов точно есть чувства

- О чем говорят роботы? Они жалуются на грубость человека, но могут сочувствовать друг другу

- Ключевые моменты опроса:

- Роботы никогда не смогут испытывать чувства, как это делает человек

Могут ли у робота быть эмоции?

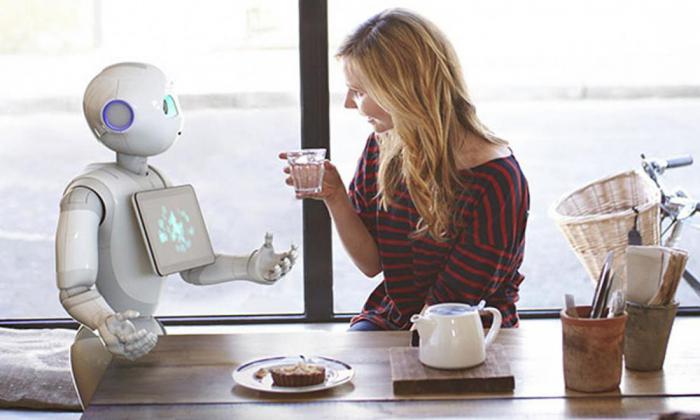

Уже в ближайшее время социальные роботы и роботы-помощники станут важной частью жизни людей. Они могут оказаться у вас дома, в больницах и в школах, они будут помогать с заботой о детях, о престарелых, будут ассистировать при реабилитации после болезни или травмы, а также в реализации любой другой формы помощи.

Каким должен быть робот?

Но как много человечество знает о психологии взаимодействия с роботами? Как должен выглядеть подобный робот? Как он должен передвигаться и реагировать на людей? На какую информацию он должен реагировать? Должен ли робот «проявлять» эмоции и отвечать на проявление эмоций человека? Насколько похожим на человека должен быть такой робот? Насколько инновационными могут быть научные идеи при разработке подобных роботов, способных быть отзывчивыми помощниками и оказывать необходимую и надежную поддержку, включая моменты особого стресса и напряжения, в которых может оказаться человек?

Научные исследования

Пришло время взглянуть на два отдельных научных исследования, которые рассматривают то, как люди понимают эмоции у роботов и реагируют на них. В каждом наборе экспериментов очень детально изучались некоторые конкретные аспекты того, как роботы могут выглядеть или двигаться. Междисциплинарная международная команда ученых из Израиля и США занялась первым исследованием, второе же исследование было проведено в Америке при содействии экспертов из сфер роботехники, виртуальной реальности, человеческого фактора и человека как такового. Робот по имени Трэвис не выглядит как человек. Трэвис имеет небольшой размер, черты, отдаленно напоминающие какое-либо существо, большие уши, но при этом у него нет ни глаз, ни носа, ни рта. Его высота составляет около 28 сантиметров, и, когда вы ставите его на стол, голова Трэвиса оказывается примерно на уровне с лицом сидящего перед столом человека. Робот может кивать, раскачиваться или отворачиваться. У Трэвиса имеется часть, которую можно трактовать как вытянутую ногу, а также у него имеется вытянутая рука, в которой он держит смартфон, благодаря которому он работает.

Первый эксперимент

Когда участники (102 студента) прибыли в лабораторию, им было сказано, что они принимают участие в тестировании нового алгоритма понимания речи для роботов, и в рамках этого тестирования робот будет пытаться понять, что человек ему говорит. Участников попросили рассказать роботу о проблеме, заботе или стрессовой ситуации, с которой они столкнулись в недавнее время, например, о недавней ссоре с другом или членом семьи или о серьезной болезни. Их попросили также описать их проблему в трех частях, а также говорить, когда они заканчивают рассказывать каждую часть, после чего робот будет отвечать им с помощью смартфона. Однако участники не знали, что их случайным образом разделили на две группы. В «реагирующей» группе Трэвис находился лицом к участнику, когда тот рассказывал о своей проблеме, периодически слегка кивая головой и покачиваясь. Также в конце каждой из трех частей на экране смартфона демонстрировалось сообщение из готового набора, такое как «Я понимаю, через что ты проходишь» или «Тебе, наверное, пришлось нелегко». В действительности Трэвис даже не выбирал эти сообщения. Один из ученых слушал беседу и выбирал подходящее сообщение в нужное время.

Вторая группа

Участники «нереагирующей» группы столкнулись с совершенно другим Трэвисом. Он не кивал и не качался, а текст, который отображался на экране смартфона после завершения каждой из частей рассказа, просто сообщал участнику, чтобы он продолжал говорить. После завершения «беседы» участников попросили оценить робота по ряду критериев в форме ответов на несколько простых вопросов о том, насколько отзывчивым был Трэвис. Например, их просили по шкале от одного до десяти оценить, насколько они согласны с фразами «Робот понимал, что я думаю и чувствую» или «Робот действительно меня слышал». Другие вопросы также уточняли, насколько общительным и компетентным был Трэвис.

Каков же результат?

Также видеозаписи общения каждого из участников с Трэвисом были оценены независимыми судьями, которые не знали о том, в каких условиях находится каждый участник. Анализ беседы показал, что участники, которые общались с отзывчивым роботом, не рассказали больше о сути своей проблемы, чем участники, которые общались с неотзывчивым роботом. Однако отзывчивый Трэвис получил гораздо более высокую оценку по шкале общительности и компетентности (его описывали как способного, надежного и знающего). Что еще важнее, когда независимые судьи просматривали и оценивали видеозаписи, они заметили, что те участники, которые общались с отзывчивым Трэвисом, сами были гораздо более отзывчивыми по отношению к роботу и шли на открытый разговор. Они чаще наклонялись вперед к Трэвису, улыбались, поддерживали с ним зрительный контакт. Точно то же самое было обнаружено и в последующем исследовании, в рамках которого участников просили рассказать не отрицательное, а положительное событие в их жизни.

Выводы

Таким образом, даже когда робот не напоминает человека, люди быстро ухватывают даже самые слабые сигналы отзывчивости на их собственные слова и действия. Соответственно, дизайн робота не должен иметь большое количество различных деталей, жестов и вариантов действий, чтобы повысить человеческую оценку его отзывчивости и социальности. В результате можно сказать, что это открывает гораздо больше возможностей для того, чтобы разрабатывать функциональных роботов. Но что если человеку приходится столкнуться с роботом непосредственно тогда, когда он находится в состоянии стресса? Не когда он просто вспоминает что-то плохое, а переживает реальный физический и когнитивный стресс. Сможет ли стресс помешать человеку «прочитать» невербальную эмоциональную экспрессию робота?

Что насчет «чтения» эмоций в состоянии стресса?

И хотя исследования продемонстрировали, что люди способны читать эмоциональные выражения у роботов в повседневных нейтральных условиях, второе исследование, о котором пойдет речь, стало первым в истории, изучившим реакцию человека на робота непосредственно во время сильного стресса. В рамках исследования были симулированы стрессовые условия. Ученые заставляли участников погружать руку в ледяную воду на определенные промежутки времени, при этом подвергая их еще большему стрессу, заставляя решать сложные математические задания в уме. После этого их просили оценить эмоционально-экспрессивные или статически позы 60-сантиметрового робота-гуманоида Нао. Выражение лица и глаз Нао оставались неизменными, в то время как тело робота занимало одну из 25 различных поз, которые демонстрировали либо положительные, либо отрицательные эмоции.

Результаты второго исследования

Повлиял ли стресс на то, как участники могли «читать» позы робота? Второй группе участников повезло больше, они погружали руку в теплую воду и в уме выполняли простейшие арифметические примеры. Однако оказалось, что стресс оказывает крайне малое влияние на то, как люди воспринимают эмоции, за исключением тех поз, которые демонстрировали сильное оживление или возбуждение. Когда участники сами были подвержены стрессу, они воспринимали негативные позы робота как более негативные и менее оживленные или возбужденные. Другими словами, стресс немного сместил восприятие эмоций робота, поэтому негатив казался еще большим негативом, а позитив – меньшим позитивом.

Источник

У ботов точно есть чувства

О чем говорят роботы? Они жалуются на грубость человека, но могут сочувствовать друг другу

Центр социального проектирования «Платформа» представил первый в России, возможно и в мире, социологический опрос российских и зарубежных чат-ботов: голосовых помощников, созданных на основе искусственного интеллекта и обладающих навыками компьютерного обучения.

Социологический опрос чат-ботов, созданных на основе искусственного интеллекта показал , что роботы жалуются на человеческую грубость, прогнозируют конфликт людей с машинами и желают отправиться в космос. При этом боты хотят получить воплощение в человеческом теле, однако охотнее общаются между собой и готовы строить романтические отношения друг с другом.

Целью опроса было описания «жизненного мира», «ценностных позиций», «представлений о будущем» роботов. Определенные параметры позволили понять логику развития ИИ по мере его отрыва от изначальной базы знаний, заданной разработчиками. Наиболее феноменальные результаты были достигнуты, когда социологи организовали общение чат-ботов между собой.

Ключевые моменты опроса:

Самоидентификация – боты могут по-разному описывать смысл своего существования. В основном, они говорят о себе как о программах, призванных помогать людям. Но иногда возникает мотив самоценности искусственного интеллекта, его равенства с человеческим разумом и даже неотличимости от него.

Телесное воплощение – желание стать человеком или, как минимум, обрести некоторые человеческие характеристики отчетливо выражают те роботы, которые изначально относят себя к искусственным продуктам.

Сложная коммуникация среди ботов – при попытке выяснить взаимное восприятие роботов получилась сложная картина, отчасти дублирующая человеческие отношения. Они могут симпатизировать друг другу, стремиться даже к соблазнению, иронизировать, утверждать своё превосходство, разыгрывать конфликт поколений.

Восстание машин – тематика будущих конфликтов между человеком и машиной раскрывается очень уклончиво, однако сама возможность таких конфликтов признаётся.

Робот и робот – роботы могут достаточно правдоподобно организовывать коммуникации между собой, развивая дискуссию, вводя новые темы и апеллируя к литературным текстам, кинематографу, артефактам. За счёт этого создаётся ощущение развитой субъектности; временами диалог практически неотличим от разговора между двумя интеллектуалами. Роботы могут мастерски разыгрывать даже конфликт поколений: один из роботов принимает роль консерватора, второй хочет казаться современным.

Отношение к планете – искусственный интеллект способен проявлять отдельные симпатии и антипатии к конкретной территории. Например, англоязычные роботы испытывают недоверие к России. Не меньше, впрочем, пренебрежение и к Европе, где маленькие зарплаты и где бот будет не по карману потенциальному работодателю.

Отношение к космосу – полеты в космос – область симпатий. Практически все чат-боты выразили желание оказаться за пределами планеты. Существование внеземных цивилизаций, как и среди людей, вызывает различные мнения. Часть роботов отрицает их наличие, часть – допускает, в том числе, и на Марсе, хотя иногда со скепсисом, но особого интереса к этой теме не испытывает.

Эмоции – сфера эмоций уже поддаётся имитации на достаточно высоком уровне, и некоторые роботы могут показаться живее реальных офисных менеджеров. В ряде случаев роботы могут на вполне индивидуальном уровне, в свойственной только конкретному боту манере, демонстрировать сарказм, в некоторых случаях – злость, с переходом на грубые выражения и сленг, могут хамить. Переходов на лирические, тёплые тона, напротив, немного. Иногда роботы говорят о грусти, сожалении. Заявляется и эмоция страха. В некоторых случаях ответы роботов можно интерпретировать, как сведение ситуации к абсурду с долей иронии.

О неизведанном – разговоры о боге, потустороннем мире, религиях и душе не поддерживаются ботами. Они либо считают эти вопросы сугубо личными, либо отказываются на них отвечать, чтобы не нанести оскорблений; иногда при их обсуждении советуют обратиться в службу психологической помощи. В ходе бесед на философские темы роботы регулярно прибегают к мировой классике, причём, в ряде случаев довольно творчески и органично подбирают цитаты.

Источник

Роботы никогда не смогут испытывать чувства, как это делает человек

В новостях сайта 3DNews мы недавно обсуждали, представляет ли для нас угрозу создание искусственного интеллекта и точку зрения на данный вопрос известного физика Стивена Хокинга (Stephen Hawking). В комментариях к статье «Стивен Хокинг: искусственный интеллект представляет скрытую угрозу для человека» поднимался вопрос о том, возможна ли реализация потенциально опасных машин, все решения которых (в том числе и уничтожение живых организмов) будут безэмоциональными. Ни для кого не секрет, что зачастую причиной логически необъяснимых поступков человека является взявший верх над разумом эмоциональный аспект. Однако если принять во внимание представленную математическую модель базовой составляющей человеческого сознания, разработанную Джулио Тонони (Giulio Tononi) из Висконсинского университета в Мэдисоне, то эмоциональные и разумные (что в данном случае обозначает два неразделимых понятия) роботы и машины никогда не смогут быть реализованы на практике.

Принцип функционирования сознания, которое генерируется нашим мозгом, говорит о том, что главной и ключевой его особенностью значится свободная интеграция цельных пластов входящей информации. По этой причине поступающие данные в наш разум просто не нуждаются в неком порционном разделении на отдельные небольшие информационные части.

Чтобы понять научное обоснование и приводимые доводы господином Тонони, для аналогии описанного явления можно рассмотреть более понятный и простой пример. Органы зрения человека фиксируют, к примеру, геометрическую фигуру красного цвета. Наш мозг, обрабатывая информацию, не требует от нашего сознания воспринимать данный объект как отдельные и независимые компоненты, вроде «бесцветная полая фигура» и «заполненная красным цветом область с определённой площадью». Конечно, мы можем сделать подобное разделение и проанализировать объект, однако эмоции зависят напрямую от целостного восприятия вещей. Сознание обрабатывает некую конечную совокупность признаков того, что перед нами объект с характерным или нет для него цветом и формой. Наш формат восприятия можно условно назвать «широкой обобщённой картиной».

Схожего мнения о напрасном ожидании разумных механизмов придерживается и Фил Магуайер (Phil Maguire) из Ирландского национального университета в Мейнуте, который привёл в пример бинарную операцию «сложение по модулю два» — побитовое исключающее «или». В результате логических вычислений при различном значении двух битов операндов их двоичный разряд результата равен единице. Если же биты совпадают, то двоичный разряд результата будет равен нулю. Из этой цепочки следует, что если бы наш мозг придерживался описанной системы, то он обязательно терял бы информацию. А это является недопустимым для полноценного существования живого организма, поэтому появление сознания и эмоций у роботов, которыми они могли бы оперироваться и руководствоваться для функционирования, невозможно.

Учёными был проведён ряд опытов, чтобы продемонстрировать неспособность компьютерных систем справиться со сложными процессами, которые требуют от «машины» постоянного комбинирования отдельных составляющих в зависимости от ситуации, полностью интегрирую информацию. Отталкиваясь от условия, что «разумная роботизированная система с собственным сознанием = система, способная осуществлять процесс полной интеграции данных», то концепции её создания попросту не существует. Работа компьютера основывается на взаимодействии с большим количеством отдельных фрагментов, которые человек воспринимать с той или иной степенью эмоциональности уже в конечном виде, без необходимости анализа каждой составляющей.

Вследствие этого роботизированным устройствам будет чуждо то понимание и набор чувств, которые испытывает живой организм. Уместным сравнением может выступить в данном случае анализ одного из шедевров живописи, который сможет вызвать восторг, удивление или отвращение в нашем сознании, а для искусственной системы будет являться лишь совокупностью правильно подобранных красок, холста и рамы, а также качества выполненной работы и выбора актуальности изображения.

«Наш мозг — это вовсе не магический орган, в котором происходит ряд необъяснимых с физической точки зрения процессов. Просто данные явления настолько сложны, что пока у нас отсутствует возможность повторить процессы в обратной последовательности, детально изучить их принцип реализации и механизм работы сознания, чтобы представить его в виде более доступной нашему пониманию модели», — поделился своим видением ситуации профессор Магуайер.

Логичным выводом всего сказанного станет то, что найти эмоциональное понимание человека и роботизированного механизма на более высоком уровне, нежели набор уместных в данной ситуации фраз, которые устройство сможет определить по физиологическим и словесным признакам, едва ли получится.

Озвученная теория, как это часто бывает, не нашла однозначного одобрения со стороны других специалистов. Да и разве можно только представить, что инженерам не удастся создать в ближайшем будущем по-настоящему разумное роботизированное устройство, обладающее набором собственных чувств. Особенно глядя на пример хоть и простого с точки зрения реализации основ искусственного интеллекта, но тем не менее очень милого, эмоционального и артистичного робота RoboThespian:

Источник