Рынок систем детекции и распознавания: Эмоции и «эмоциональные вычисления»

В наши дни технологии по распознаванию перестают быть недосягаемыми. Распознавание эмоций и «эмоциональные вычисления» являются частью большого пласта науки, также включающего такие основополагающие понятия, как распознавание образов и обработка визуальной информации. Этим постом мы хотим открыть наш блог на Хабре и провести небольшой обзор решений, представленных на рынке систем распознавания эмоций — взглянем, какие компании работают в этом сегменте и чем конкретно они занимаются.

Системы распознавания эмоций (EDRS)

Рынок систем детекции и распознавания эмоций (EDRS) активно развивается. По оценкам ряда экспертов, он продемонстрирует среднегодовой рост в 27,4% и достигнет планки 29,1 млрд долларов к 2022 году. Такие цифры вполне оправданны, поскольку программное обеспечение для распознавания эмоций уже позволяет определять состояние пользователя в произвольный момент времени при помощи веб-камеры или специализированного оборудования, параллельно анализируя поведенческие паттерны, физиологические параметры и изменения настроения пользователя.

Системы, считывающие, транслирующие и распознающие данные эмоциональной природы, можно разбить на группы по типу определения реакций: по физиологическим показателям, мимике, языку тела и движениям, а также по голосу [о последних двух вариантах определения реакций мы более подробно поговорим в последующих материалах].

К физиологии как источнику информации об эмоциях человека нередко прибегают в клинических испытаниях. Например, этот способ детекции эмоций был встроен в метод БОС (биологической обратной связи), когда пациенту на экран монитора компьютера «возвращаются» текущие значения его физиологических показателей, определяемых клиническим протоколом: кардиограмма, частота сердечных сокращений, электрическая активность кожи (ЭАК) и др.

Подобные приемы нашли применение и в других сферах. Например, определение эмоций по физиологическим данным является ключевой функцией устройства MindWave Mobile от NeuroSky, которое надевается на голову и запускает встроенный датчик мозговой активности. Он фиксирует степень концентрации, расслабления либо беспокойства человека, оценивая ее по шкале от 1 до 100. MindWave Mobile адаптирует способ регистрации ЭЭГ, принятый в научных исследованиях. Только в этом случае система оснащена всего одним электродом, в отличие от лабораторных установок, где их количество превышает десять.

Примером детекции эмоциональных реакций по мимике может служить сервис FaceReader нидерландской компании Noldus Information Technology. Программа способна интерпретировать микроэкспрессии лица, распределяя их по семи основным категориям: радость, грусть, гнев, удивление, страх, отвращение и нейтральная (neutral). Кроме того, FaceReader умеет с достаточно высокой точностью определять по лицам возраст и пол человека.

Принципы работы программы базируются на технологиях компьютерного зрения. В частности, речь идет о методе Active Template, заключающемся в наложении на изображение лица деформируемого шаблона, и методе Active Appearance Model, позволяющем создавать искусственную модель лица по контрольным точкам с учетом деталей поверхности. По словам разработчиков, классификация происходит посредством нейронных сетей с тренировочным корпусом в 10 тыс. фотографий.

В этой области заявили о себе и крупные корпорации. Например, компания Microsoft занимается развитием собственного проекта под названием Project Oxford — набора готовых REST API, реализующих алгоритмы машинного зрения (и не только). Программное обеспечение умеет различать по фотографии такие эмоции, как гнев, презрение, отвращение, страх, счастье, грусть и удивление, а также сообщать пользователю об отсутствии каких-либо зримо выраженных эмоций.

Важно отметить тот факт, что над системами распознавания эмоций работают и российские компании. Например, на рынке представлена EDR-система EmoDetect. Программное обеспечение решения способно определять психоэмоциональное состояние человека по выборке изображений (или видео). Классификатор выявляет шесть базовых эмоций — уже упомянутые выше радость, удивление, грусть, злость, страх и отвращение.

Распознавание ведется на основе 20 информативных локальных признаков лица, характеризующих психоэмоциональное состояние человека (ASM). Также производятся расчет двигательных единиц и их классификация по системе кодирования лицевых движений П. Экмана (FACS Action Units). Помимо этого, решение строит графики динамического изменения интенсивности эмоций испытуемого во времени и формирует отчеты о результатах обработки видео.

Кроме того, в рамках этого поста нельзя обойти стороной и тему отслеживания эмоций по данным движений глаз, основные параметры которых — это фиксации и саккады. Наиболее распространенный метод их регистрации носит название видеоокулография (или айтрекинг, более привычная калька с английского термина), принцип которой заключается в записи видео движения глаза с высокой частотой. В видеоокулографии имеется и свой инструментарий — айтрекеры, задействованные в экспериментальных исследованиях разного типа.

Так, компания Neurodata Lab совместно с командой разработчиков из Ocutri создала прототип софтового айтрекера Eye Catcher 0.1, позволяющего извлекать данные движений глаз и головы из видеофайлов, записанных на обычную камеру. Эта технология открывает новые горизонты в изучении движений глаз человека в естественных условиях и ощутимо расширяет исследовательские возможности. Помимо этого, линейки айтрекинговых устройств выпускают такие компании глобального значения, как SR Research (EyeLink), Tobii, SMI (приобретенная на днях корпорацией Apple), а также GazeTracker, Eyezag, Sticky и др. Основным рабочим инструментом последних тоже является веб-камера.

К сегодняшнему дню видеоокулография применяется как в науке, так и в игровой индустрии и онлайн-маркетинге (нейромаркетинге). Решающее значение при покупке в онлайн-магазине играет месторасположение информации о продукте, способствующей конверсии. Требуется и досконально учитывать позиции баннеров и прочей визуальной рекламы.

Например, Google работает над оформлением поверхностей отображения на странице выдачи с использованием айтрекинга, чтобы генерировать максимально эффективные предложения для рекламодателей. Окулография предлагает обоснованный, корректный метод анализа, оказывающий значительную практическую помощь веб-дизайнерам и способствующий тому, чтобы информация above the fold лучше воспринималась пользователями.

Affective computing — «эмоциональные вычисления»

Ключевой вектор развития внедряемых в жизнь человека новых информационных технологий — это улучшение человеко-машинного взаимодействия — human-computer interaction (HCI). Появление EDR-систем привело к возникновению такого понятия, как эмоциональные вычисления, или же по устоявшейся англоязычной терминологии — affective computing. Affective computing — это вид HCI, при котором устройство способно детектировать и соответствующим образом реагировать на чувства и эмоции пользователя, определяемые по мимике, позе, жестам, речевым характеристикам и даже температуре тела. Любопытны в связи с этим и решения, обращающиеся к подкожному кровотоку (как это делает канадский стартап NuraLogix).

Количество проводимых исследований и объемы финансирования говорят о том, что это направление является чрезвычайно перспективным. По данным marketsandmarkets.com, рынок affective computing вырастет с 12,2 млрд долларов в 2016 году до 54 млрд долларов к 2021 году при среднегодовом темпе роста 34,7%, хотя львиная его доля, как и ранее, останется за ведущими игроками рынка (Apple, IBM, Google, Facebook, Microsoft и др.).

Признание статуса эмоциональных вычислений как самостоятельной научно-исследовательской ниши и рост публичного интереса к этой сфере наблюдается приблизительно с 2000 года, когда Розалинд Пикард (Rosalind Picard) опубликовала свою книгу под знаковым названием «Affective Computing» — именно эта монография положила начало профильным исследованиям в MIT. Позднее к ним подключились ученые и из других стран.

Информация в нашем мозгу эмоционально предопределена, и мы часто принимаем решения просто под воздействием того или иного эмоционального импульса. Именно поэтому Пикард в своей книге представила идею конструирования машин, которые были бы непосредственно связаны с человеческими эмоциями и даже способны оказывать на них воздействие.

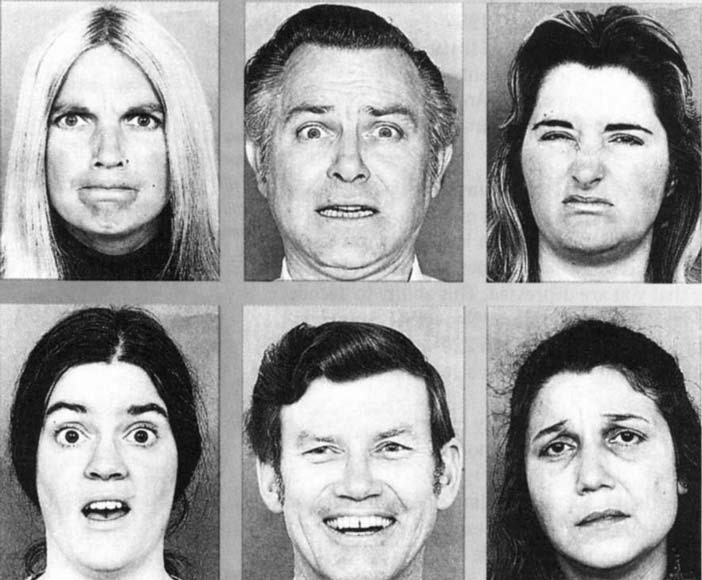

Наиболее обсуждаемым и распространенным подходом к созданию приложений affective computing является построение когнитивной модели эмоций. Система генерирует эмоциональные состояния и соответствующие им экспрессии на основании набора принципов [формирования эмоции], вместо строгого набора пар «сигнал — эмоция». Её также часто объединяют с технологией распознавания эмоциональных состояний, которая ориентируется на признаки и сигналы, проявляющиеся на нашем лице, теле, коже и т. д. На изображении ниже представлены несколько эмоций, классифицируемых по мимическому каналу:

Эмоции: злость, страх, отвращение, удивление, счастье и грусть (источник)

Эмоции считаются определяемыми процессами. Поэтому задачей affective computing становится достижение взаимодействия с пользователем в манере, приближенной к обыденному человеческому общению — машина должна подстраиваться под эмоциональное состояние пользователя и влиять на него. Для такого подхода были даже придуманы правила, сформулированные американскими исследователями Ортони, Клором и Коллинзом (Ortony, Clore and Collins).

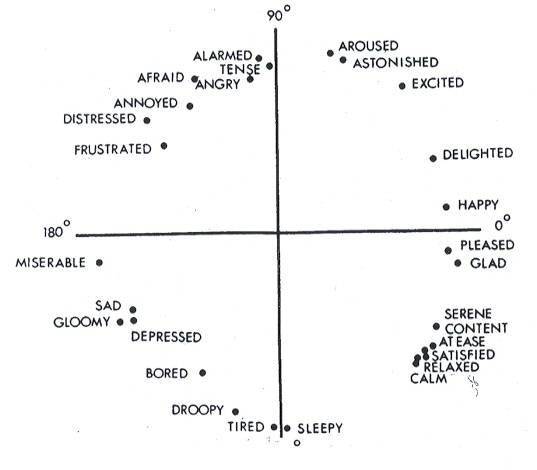

Среди релевантных примеров систем «эмоциональных вычислений» стоит выделить работу Розалинд Пикард и её коллег. С целью повышения результативности обучения студентов учеными была предложена оригинальная эмоциональная модель, построенная на базе циклической модели Рассела. В конечном счете они хотели создать электронного компаньона, отслеживающего эмоциональное состояние студента и определяющего, необходима ли ему помощь в процессе освоения новых знаний.

Циклическая модель Рассела (источник)

Интересным применением программных решений, разрабатываемых группой Пикард в MIT, является обучение детей, страдающих аутизмом, определению собственных эмоций и эмоциональных состояний окружающих людей. Все это послужило стимулом к возникновению компании Empatica, которая предлагает потребителям (в том числе больным эпилепсией) носимые браслеты под брендом Embrace, регистрирующие кожно-гальванический рефлекс (GSR) и позволяющие в реальном времени мониторить качество сна, а также уровни стресса и физической активности.

Еще одна компания, у истоков которой стояли Розалинд Пикард и её аспирантка из MIT Рана Эль Калибу (Rana el Kaliouby), носит название Affectiva. Разработчики компании выложили свой SDK на платформе Unity, открыв доступ сторонним разработчикам для экспериментов, тестов и реализации всевозможных микропроектов. В активе у компании на текущий момент крупнейшая в мире база проанализированных лиц — более пяти миллионов экземпляров, а также опыт первопроходца в ряде индустрий, где до того технология распознавания эмоций практически не принималась в расчет, однако анализ по-прежнему ведется только в пределах шести базовых эмоций и одного канала (микроэкспрессии лица).

В этом русле в наши дни развиваются многие лаборатории и стартапы. Например, Sentio Solutions разрабатывает браслет Feel, отслеживающий, распознающий и собирающий данные об испытываемых человеком эмоциях в течение дня. Одновременно мобильное приложение предлагает рекомендации, которые должны сформировать у пользователя положительные, с эмоциональной точки зрения, привычки. Встроенные в браслет сенсоры мониторят сразу несколько физиологических сигналов, таких как пульс, кожно-гальванические реакции, температуру кожи, а алгоритмы системы переводят биологические сигналы на «язык» эмоций.

Стоит упомянуть и компанию Emteq. Их платформа Faceteq не только способна отслеживать состояние водителя автомобиля [усталость], но и используется в медицинских целях — специальное приложение оказывает практическое содействие людям, страдающим от паралича лицевого нерва. Ведутся работы и по внедрению решения в сферу виртуальной реальности, что позволит VR-шлему проецировать эмоциональные реакции пользователя на аватар.

Будущее

Сегодня, в 2017 году, стратегической целью исследований в области «эмоциональных вычислений» и EDRS является выход за пределы узких рамок моно- или биканальной логики, что позволит приблизиться к реальным, а не сугубо декларируемым (положим, механически объединяющим микроэкспрессии с носимыми биодатчиками или айтрекингом), сложным мультимодальным технологиям и методам распознавания эмоциональных состояний.

Компания Neurodata Lab как раз и специализируется на разработке высокоинтеллектуальных технологических решений по распознаванию эмоций и внедрении технологий EDRS в различные отрасли экономики: масс-маркетные проекты, интернет вещей (IoT), робототехнику, индустрию развлечений, интеллектуальные транспортные системы и цифровую медицину.

При этом наблюдается плавный переход от анализа статических фотографий и изображений к динамике аудиовидеопотока и коммуникативной среды в разнообразных её проявлениях. Все это задачи нетривиальные, решающие многие узловые проблемы отрасли и требующие проведения углубленных исследований, сбора огромных массивов данных и комплексной интерпретации реакций человеческого тела (вербальных и невербальных).

Людям неинтересно общаться с неэмоциональными агентами, со стороны которых нет никакой эмоциональной отдачи, никакого отклика. Ученые прикладывают значительные силы, чтобы кардинально изменить ситуацию, однако они сталкиваются с определёнными сложностями. Одна из них — отсутствие в вычислительных системах нейронов. Внутри таких систем имеются только алгоритмы, и это объективная данность.

Человечество пытается понять, каким образом формируются те или иные психологические феномены, чтобы воспроизвести их внутри вычислительных систем. Например, этим занимается правительство США, разрабатывая архитектуру TrueNorth, в основе которой лежат нейробиологические принципы. Процессор имеет неклассическую архитектуру, то есть не придерживается архитектуры фон Неймана, а вдохновлен некоторыми моделями работы неокортекса (о чем подробно рассказывает в своих текстах Курцвейл).

В будущем [а оно может оказаться и не столь далеким, как кажется на первый взгляд] прогресс подобных технологий даст возможность сконструировать самообучающиеся системы, не нуждающиеся в программировании. К ним придется применять совершенно иные техники обучения. И нельзя исключать того, что в результате развитие вычислительной техники пойдет совсем в другую сторону.

Источник

Исследование рынка систем распознавания эмоций

Ученые уже много лет работают не покладая рук, чтобы мощные вычислительные системы были способны адекватно уловить и идентифицировать мимику. В наши дни есть большие успехи, и дело не только лишь в совершенстве предложенных методов и алгоритмов, но и в разработке более новых. Уже достаточно много компаний предлагают программное обеспечение собственной разработки, поэтому я захотел узнать побольше о предоставляемых продуктах по распознаванию эмоций на лице человека.

Под катом много текста и картинок.

Распознавание эмоций является частью большого пласта науки, объединенного в названия «Распознавание образов» и «Обработка визуальной информации». В наши дни технологии по распознаванию перестают быть недосягаемыми и формируется новое веяние, влекущее за собой всех заинтересованных в методах идентификации и обработки найденных объектов и их признаков. Они плавно перетекают из области фантастики в реальную жизнь.

Существующие системы распознавания эмоций

Из коммерческих решений на рынке систем распознавания эмоций (emotion-recognition systems) наиболее совершенным и более интересным для рассмотрения в контексте задачи распознавания эмоций на сегодняшний день является продукт FaceReader голландской компании Noldus Information Technology.

1. FaceReader

Программа может верно интерпретировать такие выражения лица, как «счастливое», «грустное», «сердитое», «удивленное», «испуганное», «недовольное» и «нейтральное», как видно на рисунке. Кроме того, FaceReader способен по лицам людей определять их возраст, пол и этническую принадлежность. FaceReader не нуждается в обучении и дополнительной настройке.

В программе реализованы технологии компьютерного зрения. В частности, это метод Active Template, заключающийся в наложении на изображение лица деформируемого шаблона:

Также, реализован метод Active Appearance Model, с помощью которого можно создавать искусственную модель лица с учетом контрольных точек и деталей поверхности, и сравнивать ее с образцами, заложенными в память.

Классификация происходит методами нейронных сетей с тренировочным набором в 2 000 фотографий.

Возможности программы:

• средний процент распознавания эмоций равен 89%. Для некоторых эмоций он выше, для некоторых ниже;

• наклон лица может быть любым в плоскости, его система обнаружит;

• программа работает с загружаемым видео в форматах с кодеками MPEG1, MPEG2, XviD, DivX4, DivX5, DivX6, DV-AVI и uncompressed AVI, причем определять эмоции можно пофреймно, либо полностью при просмотре всего видео. Также, FaceReader может работать со статичными изображениями, а также в реальном времени, если у пользователя подключена веб-камера;

• программа прекрасно визуализирована: всегда можно посмотреть гистограммы, диаграммы, процентаж выражаемых эмоций. А на таймлайне видны проявления микровыражений в определенный промежуток времени;

• FaceReader генерирует два текстовых файла, один – это лог проявления эмоций, а другой – статический, для сопряженной с данной программой уникальной системы управления визуальными данными The Observer XT, разработанной этой же компанией.

Недостатки программы:

• FaceReader не натренирован для распознавания детей до 5ти лет;

• Если человек в очках, то распознавание эмоций неточное, либо классификация не ведется;

• Люди с разным цветом кожи по-разному воспринимаются системой, программа не до конца адаптирована;

• Повернутое лицо не детектируется.

2. eMotion Software и GladOrSad

Система eMotion Software известна тем, что ее основатели распознали эмоции на картине «Мона Лиза». Результат показал, что она была на 83% счастливой, 9% отображали отвращение, 6% страх и всего на 2% Мона Лиза сердилась.

А еще система известна тем, что это, по сути, первое коммерческое платное «коробочное» решение. Наряду с данным решением, группа разработчиков запустила сайт GladOrSad.com – соответственно, Visual Recognition взяла первенство и в открытии веб-ресурса, посвященного онлайн-распознаванию эмоций.

Первым известным пользователем eMotion Software стала компания Unilever, внедрившая систему распознавания в аппарат по продаже мороженого – Unilever Share Happy. Люди улыбаются автомату, автомат дает за улыбки бесплатное мороженое!

Если человек проявляет эмоции, улыбается, хмурится или корчит гримасу, тысячи мелких мышц лица находятся в работе. Система распознавания эмоций, или ERS (Emotion-recognition system), создает 3D — модель лица, с выявлением 12 ключевых областей, таких как уголки глаза и уголки рта.

В данных программах отслеживающий алгоритм идентифицирует те же самые эмоции, их здесь шесть: гнев, печаль, страх, удивление, отвращение и счастье, а также седьмая – это их смешение.

Программное обеспечение не особо требовательно к вычислительной машине по техническим характеристикам. О деталях реализации алгоритма неизвестно, т.к. технология держится в секрете, брошюр с пояснениями я также не нашел, к сожалению.

3. MMER_FEASy — the FacE Analysis System

Опять же, в разработке использована методология наложения на лицо определенной деформируемой маски, Active Appearance Model methodology, которая позволяет высчитывать нужные параметры в реальном времени. Работа с маской продемонстрирована на рисунке ниже:

Система использует три подключаемых модуля – MMER_Lab, MMER_GPU и MMER_Locate.

MMER_Locate обеспечивает нахождение лица на изображении, ММER_Lab классифицирует некоторые признаки данного изображения, а MMER_GPU обеспечивает эффективную работу всей системы:

Программа распознает шесть базовых эмоций, также предоставляет услуги по нахождению по лицам людей возраста, пола и этнической принадлежности. Также система идентифицирует персону если при этом когда-либо ранее эталонная фотография была загружена в базу.

В дополнительные возможности программы входит подключение к другим программам ее как модуля для удаленных ассистентов, ассистентов водителей, маркетинговых исследований и домашних мультимедиа – сервисов.

Недостатками программы можно считать не полный охват загружаемых данных, т.к. работать можно только с веб-камерой. Плохие результаты и по выгрузке данных, где можно просмотреть только «аватаризацию» лица, т.е. вместо маски подставляется это же лицо, но с другой мимикой.

4. FaceSecurity

FaceVACS-DBScan with Examiner:

Разработка предназначена для обработки уникальных баз и банков данных какой-либо категории людей, к примеру, сотрудников по работе.

Данный продукт представляет собой воплощение биометрической идентификации по эталону образцов из базы.

В новой версии программы система использует новый алгоритм сравнения B5T8 вкупе со старым A14T8, призванный улучшить определяемое сходство.

Кроме того, новый компонент Examiner допускает автоматические преобразования изображения для сравнения в галерее. Это позволяет разработанным операторам смотреть списки потенциальных партнеров при сохранении полного аудита для каждого шага в процессе.

Также данная разработка помогает следователям идентифицировать лица в местах преступления по фотографии и видеонаблюдению путем сопоставления изображений лиц в хранилище агенств.

FaceVACS-Examiner также предоставляет набор инструментов, которые помогают инспекции идентифицировать лицо своевременно, что позволяет следователям действовать в соответствии с результатами поиска в самый минимальный отрезок времени после совершения преступления.

Особенности:

• Кластерная конфигурация для многомиллионной обработки базы данных людей;

• Гибкое и удобное управление списком, который позволяет сортировать его, просматривать и фильтровать;

• Пакетное и интерактивное обучение, идентификация;

• Глубокое и гибкое управление связанных данных;

• Перенастраиваемые логи;

• Прегенерация баз данных (т.е. предварительная быстрая преднастройка перед выдачей результата);

• Доступны множества различных поисковых выборок по базе.

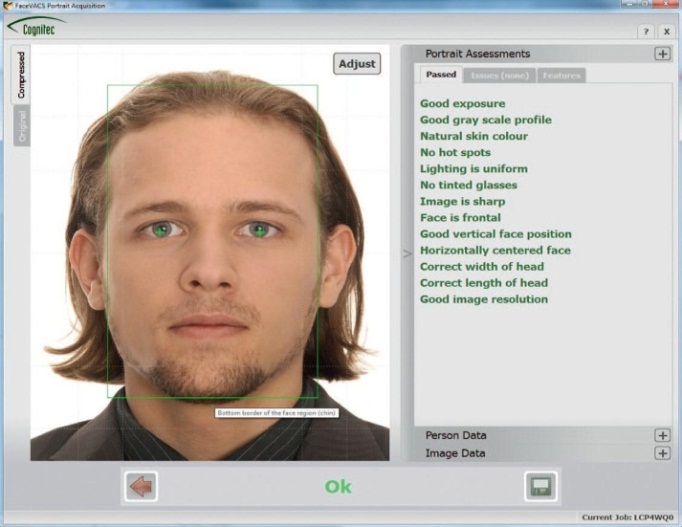

FaceVACS-PortraitAcquisition:

Создание и оценка цифровых портретов для фотодокументов, удостоверяющих личность. Работа компонента иллюстрирована рисунке:

Данный компонент упрощает производство портретов высокого качества для фото на паспорт, водительские права и прочие документы, которые подходят для распознавания лиц.

Графический пользовательский интерфейс продукта специально подстроен для визуального управления и оперирования процессом обработки таких мелочей как фронтальная поза, равномерное освещение, очки и зажмурившиеся глаза. Программное обеспечение специально настроено для оценки на соответствие изображения обязательным требованиям и лучшим практическим рекомендациям стандарта ISO 19794-5 фронтального типа изображения. Программа поддерживает интеграцию с помощью веб-служб (SOAP) для облегчения выдачи сделанного документа.

Особенности:

• Полное соответствие стандартам ISO 19794-5;

• Надежный и автоматизированный процесс сбора информации;

• Проверка фронтальной позы, наличия очков, равномерного освещения, размера головы, размеров изображения, открытия рта, поворота головы, проверка на тонированные стекла, на красные глаза, фронтальный взгляд глаз, экспозиции, цвета кожи, горячих точек, резкости;

• Удобный графический интерфейс пользователя;

• Настраиваемые параметры и пороговые значения;

• Поддерживается формат цифровых зеркальных фотокамер от Nikon (D5000) и Canon (EOS 1000D и 1100D EOS);

• Гибкая обрезка, при необходимости;

• Настраиваемое изображение при предпросмотре (размер, тип изображения, формат изображения);

• Гибкая интеграция с веб-сервисами.

FaceVACS-VideoScan:

Новое поколение компьютерного видеонаблюдения автоматически сканирует входящий видеопоток, обнаруживает несколько лиц и проверяет наличие возможных совпадений в «контрольном списке». Если соответствие найдено, операторы получают уведомления в реальном времени.

Приложение включает в себя не только выявление нежелательных людей в общественных местах, а также идентификацию высокопоставленных клиентов.

Особенности:

• Автоматическая слежка за лицом в реальном времени на нескольких видеопотоках;

• В режиме реального времени лицо сравнивается с эталонами «контрольного списка»;

• Регистрации при неподвижном изображении или при живом потоке видео в ручном и автоматическом режиме;

• Применение С++ API и Web Services API;

• Возможность масштабируемости в пределах «контрольного списка»: размер, количество видеопотоков и число видимых лиц на изображении.

Возможности программ Cognitec:

• Чрезвычайно высокая обработка сравнений по образцам (900 000 сравнений в базе за секунду на среднем по силе процессоре);

• Интеграция с веб-камерами, http – камерами, цифровыми фотоаппаратами, видеокамерами, а также поддержка изображений в распространенных форматах;

• Объемные базы данных, интеграция с Oracle, IBM DB2, MSSQL Server.

Недостатки:

• Вычисления практически во всех компонентах применимы только к фронтально расположенным лицам (возможны отклонения на 15 градусов, но не больше);

• Свет играет большую роль – к примеру, изображение лица в тени компоненты не распознают.

Нельзя не упомянуть о нашумевшем web-решении на базе FaceVACS-SDK и FaceVACS-DBScan, портале MyHeritage.com, где можно строить свое семейное дерево на основе распознавания лица, а также сравнить себя со знаменитостями, сделать морфинг лица, а также распознать и обозначить себя на фото.

Помимо Web-приложений, Cognitec предоставляет API для цифровых рекламных щитов — билбордов (billboard) с целью показа рекламы для целевых аудиторий.

Как уже упоминалось выше, Cognitec участвует и в машиностроении, системы данной компании применяются в автомобилях для анализа лиц водителей и попутчиков, а также безопасности, например, путем выявления позиции головы, обнаружения рассеяного взгляда, обнаружения закрытых глаз.

Еще одним выгодно выделяющим моментом Cognitec среди других компаний является наличие своего собственного SDK для мобильных телефонов.

5. Продукты Affective Computing Research Group

Компания Розалинды Пикард, Affectiva, известна в первую очередь поставляемыми носимыми биосенсорами Q-Sensor. Но не только этим богата компания. Есть огромный опыт внедрения технологий среди Affective computing, или эмоциональных вычислительных систем, разработки идут с 1995 года. Проектов очень много. Это самая старейшая группа разработчиков, занимающаяся данными технологиями.

Есть, например, проект AffQuake на базе продукта ID Software Quake 3. Суть в том, чтобы игра реагировала на эмоциональные сигналы игрока. Геймера обвешивают датчиками, и если ему становится страшно, модифицированный Quake получает «физиологические сигналы» пользователя и заставляет точно так же бояться виртуальное воплощение игрока – оно в страхе отступает.

Или, к примеру, разработана игрушка «Эмоциональный тигр» (Affective Tigger). Данный робот может идентифицировать пять эмоциональных состояний играющего с ним ребёнка и выразить в ответ свою эмоцию. Если ребёнок прыгает, весело тискает и целует игрушку, то система распознавания эмоций и сенсорная система «тигра» это физическое воздействие фиксируют, после чего демонстрируется счастье: Affective Tigger смеётся и улыбается.

Есть занимательное решение для Web. Это инновационный продукт компании Affectiva, сбор данных об эмоциональном состоянии людей во всемирной паутине, Affdex. По большей части он используется для маркетинговых исследований.

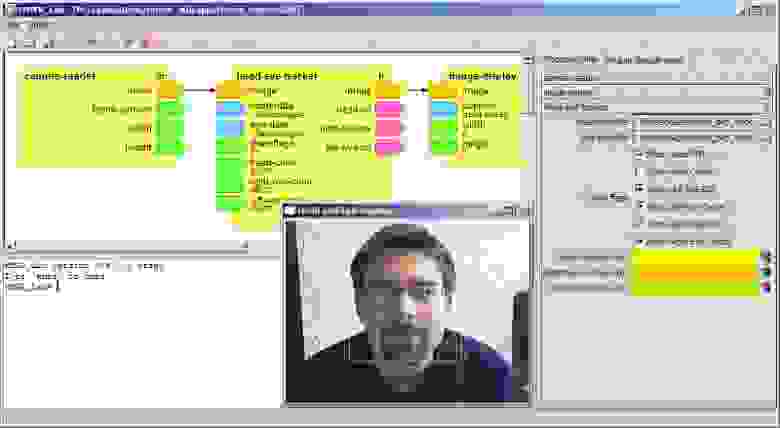

Одним из способов распознавания эмоционального состояния по лицу в данных разработках является запись в реальном времени с последующим компьютерным анализом — методами сравнения с заложенными образцами (SURF и на основе SIFT- дескрипторов), а также вейвлет-методами. Работа данных методов применяется в такой программе как Pupeteer, оценивающей поведение и эмоциональное состояние учеников. Демонстрация работы программы:

В ходе эксперимента по данному методу шесть базовых эмоций компьютер определяет с 96-процентной точностью.

Решение примечательно еще тем, что распознает вкупе с эмоциями движения головы, такие как кивок или качание, мотания из стороны в сторону. Используются процессы Байесовского машинного обучения для классификации эмоций, а также для вычисления статистики и вычисления смешанных состояний, когда нельзя точно выразить, какая именно эмоция превалирует.

О самом программном обеспечении можно не многое сказать, так как технологии закрыты. Разработка ведется на С++, Objective C для iPhone. Графически оформляется через обычные инструменты, такие как timeline (или шкала времени), графики и диаграммы, что видно на следующем рисунке:

Среди особенностей можно заметить, что все решения хорошо прорисованы и адаптированы под заказчика, а из недостатков, пожалуй, наибольшим является наличие вычислительной машины с неслабым процессором (выше Core i5) для комфортной работы с приложениями.

Сравнение компаний и промежуточные итоги

Рассмотрены решения лишь некоторых игроков данного бизнеса. Остальные компании предоставляют свои продукты, предназначенные немного для иных задач, но разрабатываемые ими системы так или иначе интересны, потому что могут быть легко усовершенствованы до уровня распознавания эмоций. Это программы и решения, выполняющие такие задачи как:

• верификация лица (системы безопасности и контроля доступа);

• трекинг и отслеживание лица (системы видеонаблюдения);

• сравнение людей по образу и подобию своему (системы поиска);

• анимация лица и его преобразование (системы морфинга);

• преобразование лица в 3D – модели (системы моделирования);

• определение расы, возраста и пола человека (системы гендерной классификации);

• многое другое.

Причем большинство компаний, разрабатывающих данные программы, предоставляют свой инструментарий (SDK – Software Development Kit) любому разработчику.

Ключевым критерием применения таких продуктов является их стоимость, а также стоимость предоставляемого SDK. Она колеблется от 5$ до 2 000$. Наиболее дорогостоящие продукты вряд ли будут применяться в небольших компаниях, где разработки такого рода не являются условием работы всей компании.

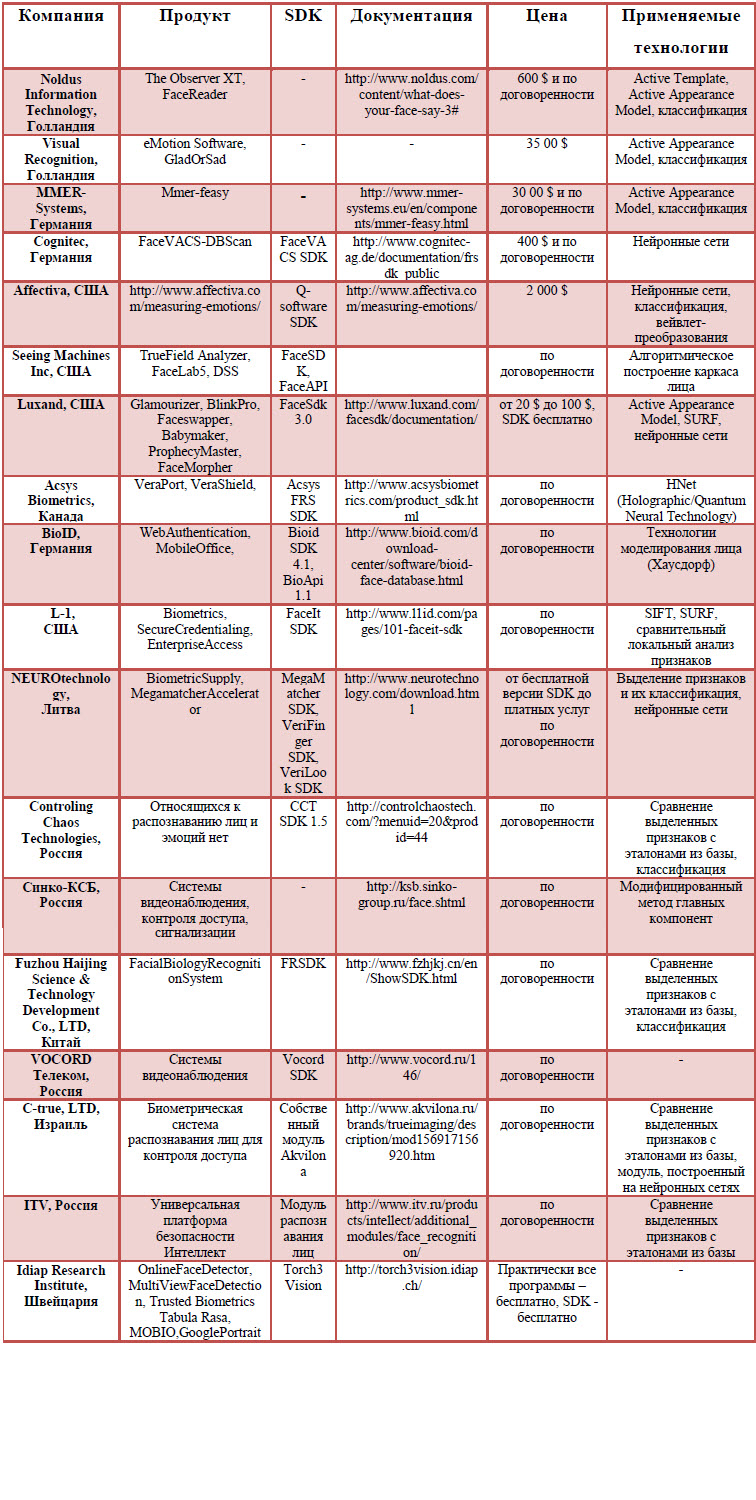

Ниже, в таблице, привожу список таких программ и комплексов программ. Конечно же, список со временем будет расширяться, но по состоянию на ноябрь 2011 года он актуален:

Актуальна деятельность компаний, ориентированных на web-разработки и технологии. Таковыми являются Google, Twitter, FaceBook и многие другие. Google Inc. применяет технологии распознавания лиц и эмоций для более умного поиска, Twitter оценивает настроение пишущих в онлайн-блогах людей, FaceBook недавно представил обществу новую фичу (усовершенствование) под названием Tagger, которая автоматически распознает, отмечает и подписывает лица друзей пользователя социальной сети.

Разработчики компании Face.com известны своими разработками, а также своей собственной SDK на JavaScript, которую использует PhotoTagger.

Недавно данной компанией была представлена технология, которая позволяет идентифицировать людей по фотографиям, опубликованным на Интернет-сайтах. Программа PhotoFinder анализирует цифровые изображения, найденные на страницах глобальной сети и сравнивает их с эталонным изображением искомого лица, подлинность которого не вызывает сомнения. Для обработки эталона используется алгоритм, который основывается на уникальном расположении различных частей лица — глаз, носа и рта. Вроде ничего нового, но такое программное обеспечение позволяет сконструировать огромнейшую базу пользователей сети Интернет. Данная технология реализована в виде виджетов и может встраиваться создателями web-порталов на их сайты. Поиск ведется как по фотографиям, так и по видео. Данный сервис уже оценили такие компании как Flickr и YouTube. Сторонники технологии считают, что разработка упростит поиск и установление личности. Но есть политика конфиденциальности, которую нарушать нельзя.

Не отступают и компании, представляющие данные инновации в своих продуктах, таких как цифровые фото- и видеокамеры. Таких компаний очень много, среди них Ricoh, Fujifilm, Canon, Nikon и другие.

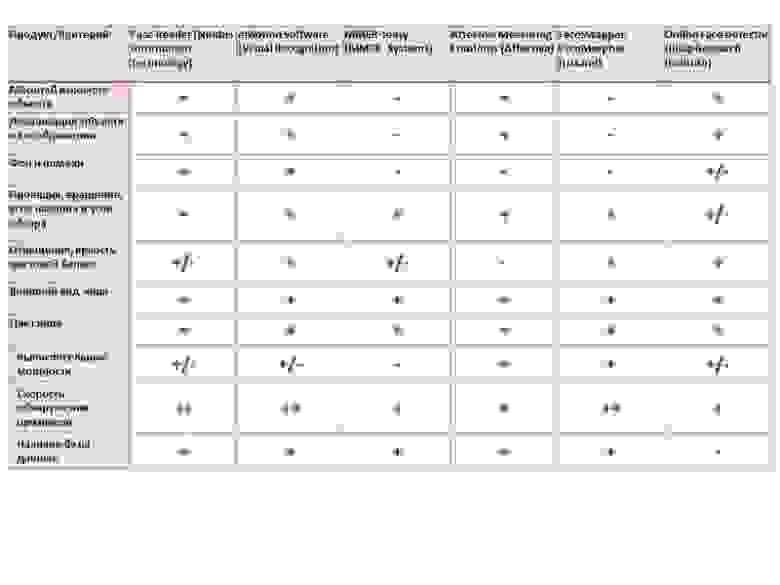

Разобраны многие продукты компаний, есть достоинства программного обеспечения компаний, а также и недостатки. На основе данной информации мной было принято решение построить таблицу соответствия продуктов определенным критериям, главным для распознавания и выяснить сильные и слабые стороны таких модулей распознавания эмоций:

Выводы

Хотя некоторые компании утверждают, что их продукт чтения эмоций лица является наиболее правильным, важно отметить тот факт, что на сегодняшний день технологии есть, но они распознают только черты, присущие и наиболее подходящие данному выражению лица. Но далеко не всегда можно сказать, действительно такое чувство испытывает человек или же это просто натренированная улыбка, к примеру. Если же добиваться результата такого, чтобы внешнее выражение соответствовало внутренним чувствам пользователя программы, то, на мой взгляд, важно убедиться, что участнику действительно удобно и комфортно выражать свои чувства изнутри и проявлять их на своем лице, и что он этого хочет. Это достигается с использованием полного комплекса технологий, каковыми являются распознавание эмоций, распознавание выражения лица, распознавание речи и интонаций во время разговора данного человека, определение смысловой нагрузки и эмоциональных переживаний при письме и компьютерной переписке – всё это очень влияет на конечный результат. Также, можно использовать датчики.

Как видно из обзора, продукты представлены многими компаниями и в разном виде: от коробочных версий программного обеспечения до веб-решений на основе модели SaaS (Software as a Service – программное обеспечение как услуга) и применений в различных видах техники. Выявлены особенности и недостатки.

В финансовом плане спектр услуг сильно разнится, но подавляющее большинство мультифункциональных решений стоит дорого. Тем не менее, востребованность таких систем растет.

Спасибо за внимание! Пожалуйста, не пинайте автора слишком сильно, это мой первый топик на Хабре… но продолжение следует.

Источник