- Хороший, плохой, злой: возможен ли эмоциональный искусственный интеллект

- Владимир Ильин

- С каждым годом разработки в сфере искусственного интеллекта становятся все совершеннее — технология распознавания лиц, (действительно) толковые голосовые помощники и даже искусство, созданное алгоритмами, становятся частью нашей жизни. Остается подождать, когда искусственный интеллект возьмет последний рубеж человеческих возможностей и научится испытывать эмоции, а сценарий фильма «Она» станет реальностью. Возможно ли это на самом деле? Или машины так и останутся послушными, но холодными слугами человека? T&P разбираются, как искусственный интеллект обучают чувствам, почему эти разработки так необходимы для нашей повседневности и что обещает будущее, где машины сравняются с человеком.

- Сакральное против познания

- Наладить коммуникацию

- Научить эмоциям

- Эволюционная гонка

- Введение в задачу распознавания эмоций

- Что такое эмоции?

- Классический подход к задаче классификации эмоций

- Классификация эмоций с применением deep learning

- Классификация эмоций по речи

- Аудиовизуальное распознавание эмоций

Хороший, плохой, злой: возможен ли эмоциональный искусственный интеллект

Владимир Ильин

С каждым годом разработки в сфере искусственного интеллекта становятся все совершеннее — технология распознавания лиц, (действительно) толковые голосовые помощники и даже искусство, созданное алгоритмами, становятся частью нашей жизни. Остается подождать, когда искусственный интеллект возьмет последний рубеж человеческих возможностей и научится испытывать эмоции, а сценарий фильма «Она» станет реальностью. Возможно ли это на самом деле? Или машины так и останутся послушными, но холодными слугами человека? T&P разбираются, как искусственный интеллект обучают чувствам, почему эти разработки так необходимы для нашей повседневности и что обещает будущее, где машины сравняются с человеком.

Сакральное против познания

В обывательском представлении искусственный интеллект никогда не сможет приблизиться к человеческой эмоциональности из-за нашей особой душевной организации, которую невозможно трансплантировать в машину. Однако сложности с созданием эмоционального ИИ, напротив, связаны с тем, что люди не так уж хороши в эмпатии. Мы совсем не похожи на идеальные эмоциональные машины, которые могут с легкостью расшифровать чувства окружающих. Наша эмпатия серьезно ограничена уникальным опытом, усваиваемыми стереотипами и индивидуальными психоэмоциональными реакциями. Так, европеец из среднего класса вряд ли поймет, какие чувства выражает вождь африканского племени, и наоборот.

С одной стороны, мы полагаем, что эмоциональность — сакральный дар, исключительная привилегия людей. С другой — знаем о ней слишком мало, рассказывает специалист по ИИ и машинному обучению и основатель портала 22century.ru Сергей Марков. По его мнению, отказ от восприятия эмоциональности как священного позволит найти новые методы для изучения эмпатии. С помощью обратной разработки (исследование готового устройства или программы с целью понять принцип его работы и обнаружить неочевидные возможности. — Прим. T&P) исследования нейронных сетей и машинного обучения можно узнать что-то принципиально новое о человеческой эмоциональности. «Машинное обучение позволяет в ряде случаев, что называется, поверить гармонию алгеброй — на смену догадкам и гипотезам приходит более надежное знание, основанное на статистике больших данных», — полагает Марков.

Наладить коммуникацию

Возможно, мы бы и не пытались научить машины эмпатии просто из любопытства, но растущее число автоматизированных систем (от голосовых помощников до самоуправляемых автомобилей) делает эмоциональный ИИ насущной необходимостью. Главная задача, которая стоит перед специалистами по машинному обучению, — упростить работу с разными интерфейсами и на уровне ввода, и в процессе вывода информации. Частота общения с компьютерами очевидно растет, но сами сервисы и системы пока не понимают, почему мы трясем телефоном: от злобы или от смеха.

Эмоциональный интеллект уже сейчас востребован во многих бизнес-проектах. От рекламы, которая, подстраиваясь под эмоциональное состояние потенциального клиента, увеличивает продажи, до технологий распознавания, которые, обнаружив самого нервного человека в толпе, помогут поймать преступника.

Исследователям предстоит поработать с эмоциональным интеллектом и из соображений безопасности. «Решения, которые принимаются компьютерами, не должны казаться психопатическими. Если машина действует в мире, где живут люди, она должна уметь принимать во внимание „человеческие обстоятельства“, то есть быть способной к эмпатии. Стандартный пример: робот-диагност, отправляющий пожилого человека на сложную операцию, должен учитывать риски, связанные со стрессом. Беспилотный автомобиль, начисто лишенный эмпатии, в определенном контексте тоже может натворить бед», — считает философ Кирилл Мартынов.

Алармисты вроде философа и специалиста по антропоцену Ника Бострома, отмечает Мартынов, утверждают, что проблема «потери чувствительности» у сверхразума, резко выделяющегося на фоне человеческого уровня, вполне реальна. Эту проблему пытаются предотвратить уже сейчас при помощи юридических ограничений. При таком подходе создателей ИИ законодательно обяжут наделять разработки элементами эмоционального разума, необходимыми для эмпатии.

Научить эмоциям

Нетривиальная задача создания эмоционального ИИ упрощается с появлением новых инструментов вроде машинного обучения. Сергей Марков описывает этот процесс следующим образом: «Можно взять несколько сотен тысяч аудиозаписей человеческих высказываний и попросить группу людей-разметчиков сопоставить с каждой из этих фраз набор маркеров „эмоционального алфавита“. Затем случайным образом отбираются 80% фраз — на этой выборке нейросеть обучают угадывать эмоциональные маркеры. Оставшиеся 20% можно использовать, чтобы убедиться в исправной работе искусственного интеллекта». В другой модели обучения, которую описывает Марков, нейросеть получает бо́льшую самостоятельность. В ней ИИ сам категоризирует фразы по схожей эмоциональной окраске, темпу речи и интонации, а позже учится синтезировать свои высказывания на основе полученных категорий. Так или иначе, главным ресурсом для обучения искусственного интеллекта становятся большие массивы данных.

Эволюционная гонка

Говоря о машинном обучении и удобных интерфейсах, мы концентрируемся на практических задачах и их решениях. Но как насчет появления «настоящей» (как у людей) эмоциональности у искусственного интеллекта? Сможет ли машина любить, грустить и злиться? «Тот факт, что мы переживаем наши собственные эмоции как „настоящие“, связан лишь с тем, что так настроена наша когнитивная система, возникшая в ходе эволюции. Особи, способные испытывать эмоции и контролировать свое поведение, получали преимущество в эволюционной гонке. Компьютеры вряд ли смогут приблизиться к моделированию реальной эволюции приматов — в этом смысле их эмоции не будут „реальными“», — полагает Мартынов.

Ключевой вопрос, говорит Мартынов: можно ли смоделировать субъективные переживания эмоций, то, что Аристотель назвал бы душой, а Декарт — cogito? Прямого ответа на этот вопрос наука до сих пор не дает, а философы собирают конференции о природе квалиа (нередуцируемых элементов субъективного опыта). Хотя есть и оптимисты вроде философа и когнитивиста Дэниела Деннета, которые утверждают, что в конечном счете субъективный опыт — это способность рассказывать себе и окружающим о том, что вы почувствовали. Убедительные вербальные отчеты об эмоциях мы, конечно, получим от машин в ближайшее время, думает Мартынов.

Но с большой вероятностью, полагает Сергей Марков, наше совместное будущее с эмоциональным искусственным интеллектом примет формы, которые невозможно вообразить сегодня со стереотипным противопоставлением людей и машин: «Скорее в будущем люди и машины будут объединены в гетерогенные синтетические системы, в которых вы уже не сможете провести даже условную черту, разделяющую человека и продукт его технологий. В таком сценарии эмоциональному интеллекту уготована большая роль».

Источник

Введение в задачу распознавания эмоций

Распознавание эмоций – горячая тема в сфере искусственного интеллекта. К наиболее интересным областям применения подобных технологий можно отнести: распознавание состояния водителя, маркетинговые исследования, системы видеоаналитики для умных городов, человеко-машинное взаимодействие, мониторинг учащихся, проходящих online-курсы, носимые устройства и др.

В этом году компания ЦРТ посвятила этой теме свою летнюю школу по машинному обучению. В этой статье я постараюсь дать краткий экскурс в проблему распознавания эмоционального состояния человека и расскажу и подходах к ее решению.

Что такое эмоции?

Эмоция – это особый вид психических процессов, которые выражают переживание человеком его отношения к окружающему миру и самому себе. Согласно одной из теорий, автором которой является российский физиолог П.К. Анохин, способность испытывать эмоции была выработана в процессе эволюции как средство более успешной адаптации живых существ к условиям существования. Эмоция оказалась полезной для выживаемости и позволила живым существам быстро и наиболее экономно реагировать на внешние воздействия.

Эмоции играют огромную роль в жизни человека и межличностном общении. Они могут быть выражены различными способами: мимикой, позой, двигательными реакциями, голосом и вегетативными реакциями (частота сердечных сокращений, артериальное давление, частота дыхания). Однако наибольшей выразительностью обладает лицо человека.

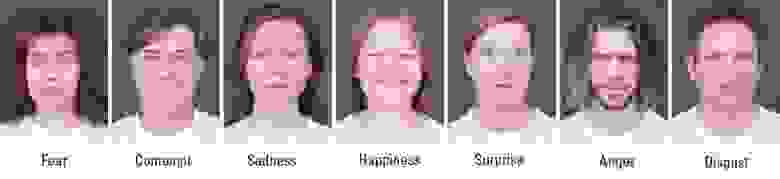

Каждый человек выражает эмоции несколько по-разному. Известный американский психолог Пол Экман, исследуя невербальное поведение изолированных племен в Папуа-Новой Гвинее в 70-х годах прошлого века, установил, что ряд эмоций, а именно: гнев, страх, печаль, отвращение, презрение, удивление и радость являются универсальными и могут быть поняты человеком, независимо от его культуры.

Люди способны выражать широкий спектр эмоций. Считается, что их можно описать как комбинацию базовых эмоций (например, ностальгия – это что-то среднее между печалью и радостью). Но такой категориальный подход не всегда удобен, т.к. не позволяет количественно охарактеризовать силу эмоции. Поэтому наряду с дискретными моделями эмоций, был разработан ряд непрерывных. В модели Дж. Рассела водится двумерный базис, в котором каждая эмоция характеризуется знаком (valence) и интенсивностью (arousal). Ввиду своей простоты модель Рассела в последнее время приобретает все большую популярность в контексте задачи автоматической классификации выражения лица.

Итак, мы выяснили, что если вы не пытаетесь скрыть эмоциональное возбуждение, то ваше текущее состояние можно оценить по мимике лица. Более того, используя современные достижения в области deep learning возможно даже построить детектор лжи, по мотивам сериала «Lie to me», научной основой которого послужили непосредственно работы Пола Экмана. Однако эта задача далеко не так проста. Как показали исследования нейробиолога Лизы Фельдман Барретт, при распознавании эмоций человек активно использует контекстную информацию: голос, действия, ситуацию. Взгляните на фотографии ниже, это действительно так. Используя только область лица, правильное предсказание сделать невозможно. В связи с этим для решения этой задачи необходимо использовать как дополнительные модальности, так и информацию об изменении сигналов с течением времени.

Здесь мы рассмотрим подходы к анализу только двух модальностей: аудио и видео, так как эти сигналы могут быть получены бесконтактным путем. Чтобы подступиться к задаче в первую очередь нужно раздобыть данные. Вот список наиболее крупных общедоступных баз эмоций, известных мне. Изображения и видео в этих базах были размечены вручную, некоторые с использованием Amazon Mechanical Turk.

| Название | Данные | Разметка | Год выпуска |

|---|---|---|---|

| OMG-Emotion challenge | aудио/видео | 7 категорий, valence/arousal | 2018 |

| EmotiW challenge | aудио/видео | 6 категорий | 2018 |

| AffectNet | изображения | 7 категорий, valence/arousal | 2017 |

| AFEW-VA | видео | valence/arousal | 2017 |

| EmotioNet challenge | изображения | 16 категорий | 2017 |

| EmoReact | aудио/видео | 17 категорий | 2016 |

Классический подход к задаче классификации эмоций

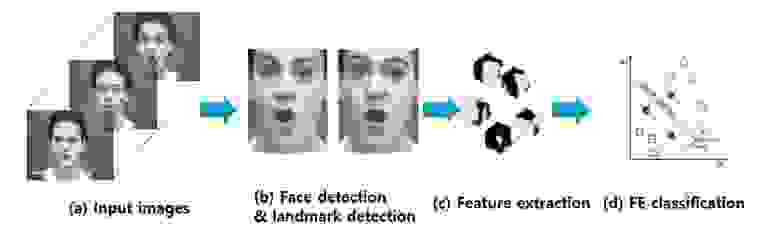

Наиболее простой способ определения эмоции по изображению лица основан на классификации ключевых точек (facial landmarks), координаты которых можно получить, используя различные алгоритмы PDM, CML, AAM, DPM или CNN. Обычно размечают от 5 до 68 точек, привязывая их к положению бровей, глаз, губ, носа, челюсти, что позволяет частично захватить мимику. Нормализованные координаты точек можно непосредственно подать в классификатор (например, SVM или Random Forest) и получить базовое решение. Естественно положение лиц при этом должно быть выровнено.

Простое использование координат без визуальной компоненты приводит к существенной потере полезной информации, поэтому для улучшения системы в этих точках вычисляют различные дескрипторы: LBP, HOG, SIFT, LATCH и др. После конкатенации дескрипторов и редукции размерности с помощью PCA полученный вектор признаков можно использовать для классификации эмоций.

Однако такой подход уже считается устаревшим, так как известно, что глубокие сверточные сети являются лучшим выбором для анализа визуальных данных.

Классификация эмоций с применением deep learning

Для того чтобы построить нейросетевой классификатор достаточно взять какую-нибудь сеть с базовой архитектурой, предварительно обученную на ImageNet, и переобучить последние несколько слоев. Так можно получить хорошее базовое решение для классификации различных данных, но учитывая специфику задачи, более подходящими будут нейросети, используемые для крупномасштабных задач распознавания лиц.

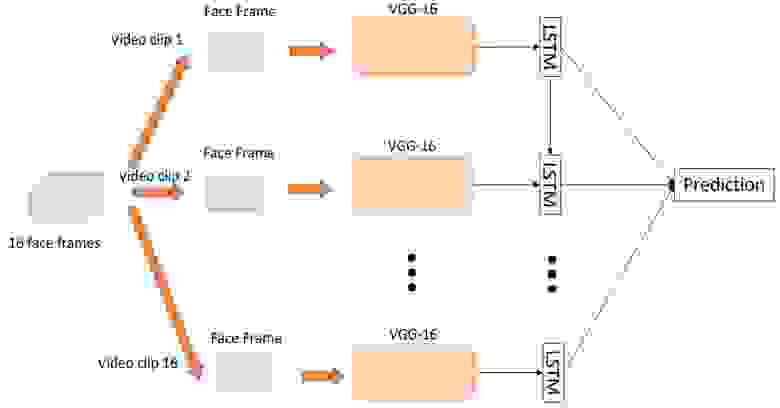

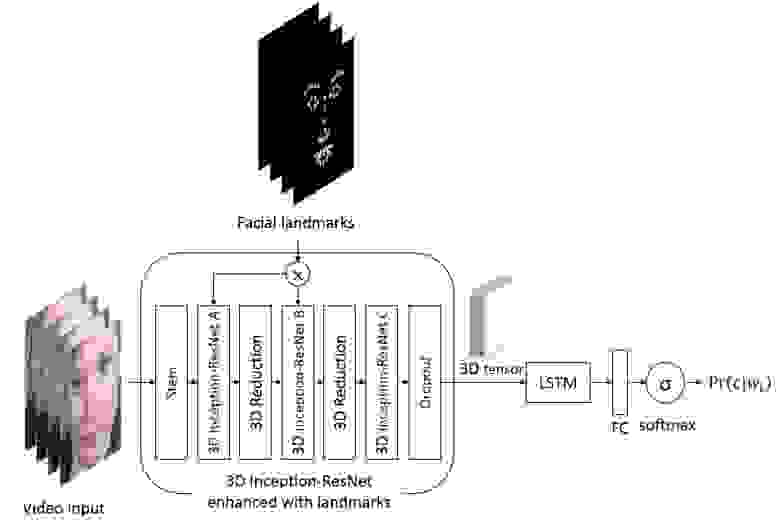

Итак, построить классификатор эмоций по отдельным изображениям достаточно просто, но как мы выяснили, мгновенные снимки не совсем точно отражают истинные эмоции, которые испытывает человек в данной ситуации. Поэтому для повышения точности системы необходимо анализировать последовательности кадров. Сделать это можно двумя путями. Первым способом является подача высокоуровневых признаков, полученных от CNN, классифицирующей каждый отдельный кадр, в рекуррентную сеть (например, LSTM) для захвата временной составляющей.

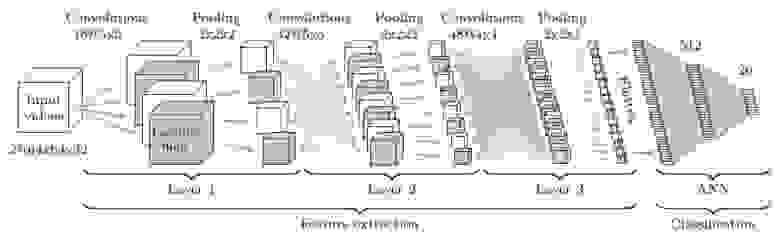

Второй способ заключается в непосредственной подаче последовательности кадров, взятых из видео с некоторым шагом, на вход 3D-CNN. Подобные CNN используют свертки с тремя степенями свободы, преобразующие четырехмерный вход в трехмерные карты признаков.

На самом деле в общем случае эти два подхода можно объединить, сконструировав вот такого монстра.

Классификация эмоций по речи

На основе визуальных данных можно с высокой точностью предсказывать знак эмоции, но при определении интенсивности предпочтительнее использовать речевые сигналы. Анализировать аудио немного сложнее ввиду сильной вариативности длительности речи и голосов дикторов. Обычно для этого используют не исходную звуковую волну, а разнообразные наборы признаков, например: F0, MFCC, LPC, i-вектора и др. В задаче распознавания эмоций по речи хорошо себя зарекомендовала открытая библиотека OpenSMILE, содержащая богатый набор алгоритмов для анализа речи и музыкальных сигналов. После извлечения, признаки могут быть поданы в SVM или LSTM для классификации.

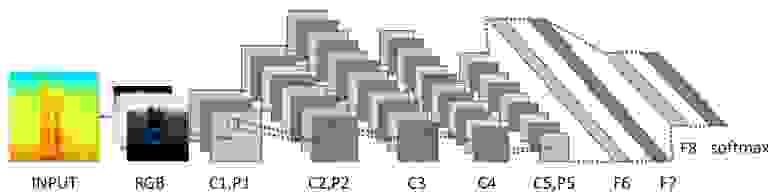

Однако в последнее время сверточные нейронные сети стали проникать и в область анализа звука, вытесняя устоявшиеся подходы. Для того чтобы их применить, звук представляют в виде спектрограмм в линейной или mel-шкале, после чего с полученными спектрограммами оперируют как с обычными двумерными изображениями. При этом проблема произвольного размера спектрограмм по временной оси элегантно решается при помощи статистического пулинга или за счет включения в архитектуру рекуррентной сети.

Аудиовизуальное распознавание эмоций

Итак, мы рассмотрели ряд подходов к анализу аудио- и видеомодальностей, остался заключительный этап – объединение классификаторов для вывода окончательного решения. Простейшим способом является непосредственное объединение их оценок. В этом случае достаточно взять максимум или среднее. Более сложным вариантом является объединение на уровне эмбеддингов для каждой модальности. Для этого часто применяют SVM, но это не всегда корректно, так как эмбеддинги могут иметь различную норму. В связи с этим были разработаны более продвинутые алгоритмы, например: Multiple Kernel Learning и ModDrop.

Ну и конечно стоит упомянуть о классе так называемых end-to-end решений, которые могут обучаться непосредственно на сырых данных от нескольких датчиков без всякой предварительной обработки.

В целом задача автоматического распознавания эмоций еще далека от решения. Судя по результатам прошлогоднего конкурса Emotion Recognition in the Wild, лучшие решения достигают точности порядка 60%. Надеюсь, что представленной в этой статье информации будет достаточно, для того чтобы попытаться построить собственную систему распознавания эмоций.

Источник